YOLOv11作为YOLO系列的最新迭代,在保持一阶段检测器高效性的基础上,实现了精度与速度的全面提升。相比YOLOv8,YOLOv11在模型架构、训练策略和损失函数设计方面都有显著改进,mAP提升约2-5%,同时推理速度更快,参数量更少。

![图片[1]-YOLOv11深度解析:架构创新与应用](https://sorry.chaofanaigc.com/wp-content/uploads/2025/07/6863d57cfd4599db6d3ae059_OpenVINO_fig2-1024x448.webp)

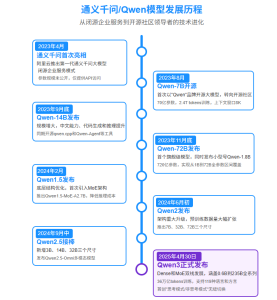

核心架构创新

1. 改进的C3k2模块:YOLOv11引入了C3k2(C3 with 2 Kernels)模块替代传统的C3模块。该模块采用双分支设计,一个分支使用3×3卷积捕获局部特征,另一个分支使用1×1卷积进行通道交互,通过残差连接融合多尺度特征表示。

2. SPPF增强:空间金字塔池化快速版本(SPPF)得到进一步优化,通过级联多个小尺寸池化核(5×5)替代大尺寸池化核,在保持感受野的同时大幅减少计算量。

3. 解耦检测头优化:检测头采用更轻量的解耦设计,分类和回归分支完全独立,减少了特征冲突。新的检测头还集成了DFL(Distribution Focal Loss)机制,提升边界框回归精度。

![图片[2]-YOLOv11深度解析:架构创新与应用](https://sorry.chaofanaigc.com/wp-content/uploads/2025/07/6863d6310b5efe13b6420ccf_OpenVINO_fig4.webp)

训练流程深度剖析

数据预处理与增强

YOLOv11采用多阶段数据增强策略:

- Mosaic增强:将4张图像拼接成一张,增强小目标检测能力

- MixUp增强:按比例混合两张图像,提升模型泛化性

- Copy-Paste增强:将目标从一张图像复制到另一张,增加样本多样性

- HSV色彩空间增强:在色调、饱和度、明度维度进行随机变换

损失函数设计

YOLOv11采用复合损失函数:

Total Loss = λ₁ × Box Loss + λ₂ × Class Loss + λ₃ × DFL Loss- Box Loss:基于CIoU(Complete IoU)的边界框回归损失

- Class Loss:二元交叉熵分类损失,支持多标签分类

- DFL Loss:分布焦点损失,将边界框回归转化为分类问题,提升定位精度

优化策略

学习率调度:采用余弦退火策略,配合线性预热机制 权重衰减:自适应权重衰减,防止过拟合 EMA更新:指数移动平均更新模型参数,提升训练稳定性

环境配置

安装必要的依赖:

pip install ultralytics

pip install torch torchvision torchaudio

pip install opencv-python

pip install pillow数据准备

YOLOv11需要使用YOLO格式的数据集,需要准备:

1.数据集目录结构:

dataset/

├── images/

│ ├── train/

│ ├── val/

│ └── test/

└── labels/

├── train/

├── val/

└── test/2.标注格式:每个图片对应一个txt文件,格式为:

class_id center_x center_y width height所有坐标都是相对于图片尺寸的归一化值(0-1)。

3.数据集配置文件(data.yaml):

path: /path/to/dataset # 数据集根目录

train: images/train # 训练集相对路径

val: images/val # 验证集相对路径

test: images/test # 测试集相对路径

nc: 80 # 类别数量

names: ['person', 'bicycle', 'car', ...] # 类别名称列表训练流程:

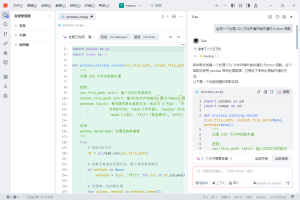

基础训练代码:

from ultralytics import YOLO

# 加载模型

model = YOLO('yolo11n.pt')

# 训练模型

model.train(

data='data.yaml',

epochs=100,

imgsz=640,

batch=16

)验证和测试

验证模型:

# 验证训练好的模型

results = model.val(data='data.yaml')推理测试:

# 加载训练好的模型

model = YOLO('runs/detect/train/weights/best.pt')

# 对图片进行推理

results = model('path/to/image.jpg')

# 显示结果

results[0].show()

# 保存结果

results[0].save('result.jpg')高级配置选项

1.数据增强配置:

model.train(

data='data.yaml',

epochs=100,

hsv_h=0.015, # 色调增强

hsv_s=0.7, # 饱和度增强

hsv_v=0.4, # 明度增强

degrees=0.0, # 旋转角度

translate=0.1, # 平移

scale=0.5, # 缩放

shear=0.0, # 剪切

perspective=0.0, # 透视变换

flipud=0.0, # 上下翻转概率

fliplr=0.5, # 左右翻转概率

mosaic=1.0, # 马赛克增强概率

mixup=0.0, # 混合增强概率

copy_paste=0.0 # 复制粘贴增强概率

)2.多GPU训练:

# 使用多个GPU

model.train(

data='data.yaml',

epochs=100,

device=[0, 1, 2, 3] # 使用GPU 0,1,2,3

)3.恢复训练:

# 从检查点恢复训练

model = YOLO('runs/detect/train/weights/last.pt')

model.train(resume=True)技术特点与优势

精度提升:通过改进的网络架构和训练策略,YOLOv11在COCO数据集上相比YOLOv8提升2-5% mAP。

速度优化:C3k2模块和轻量化检测头设计使推理速度提升15-20%,在保持精度的同时实现更快的检测速度。

部署友好:支持多种部署格式(ONNX、TensorRT、CoreML等),便于在不同硬件平台上部署。

训练稳定性:改进的数据增强策略和损失函数设计使训练过程更加稳定,收敛速度更快。

YOLOv11通过架构创新和训练策略优化,在目标检测任务中展现出优异性能。其在保持YOLO系列一贯高效特性的基础上,进一步提升了检测精度和推理速度,为实际应用场景提供了更优的解决方案。无论是工业检测、安防监控还是自动驾驶等领域,YOLOv11都能提供可靠的技术支撑。

随着深度学习技术的不断发展,YOLOv11作为当前最先进的一阶段检测器之一,必将在计算机视觉领域发挥更大的作用,推动相关应用的产业化进程。

暂无评论内容