引言:开源浪潮中的技术革命

2025年7月28日晚,北京智谱华章科技股份有限公司正式发布了新一代旗舰模型GLM-4.5,这一发布不仅在技术层面实现了多项突破,更在开源AI生态中树立了新的标杆。作为首个在单一模型中原生融合推理、编码和智能体能力的大语言模型,GLM-4.5的问世标志着中国AI技术从追赶者向引领者的重要转变。

在当前AI技术竞争白热化的背景下,GLM-4.5以其独特的技术架构和卓越的性能表现,在全球AI竞赛中占据了重要位置,特别是在开源领域达到了SOTA(State-of-the-Art)水平。

技术架构的革命性创新

原生融合的三重能力架构

GLM-4.5最显著的技术突破在于实现了推理、编码和智能体能力的原生融合。这种设计理念代表了对传统大模型架构的根本性重新思考。以往的大模型往往专注于单一能力维度的优化,而GLM-4.5通过创新的训练方法论,在不损失任何原有能力的前提下,将多种通用智能能力集成到统一架构中。

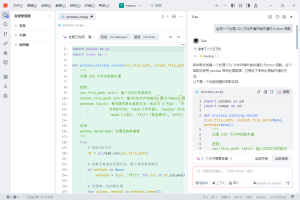

这种原生融合的实现基于混合推理模式设计,模型可以在两种工作模式间无缝切换:用于复杂推理和工具使用的思考模式,以及用于即时响应的非思考模式。这种动态切换机制通过thinking.type参数控制,为不同应用场景提供了最优的性能配置。

混合专家架构的精妙设计

GLM-4.5采用混合专家(MoE)架构,提供两个版本:

- GLM-4.5旗舰版:3550亿总参数,320亿激活参数

- GLM-4.5-Air轻量版:1060亿总参数,120亿激活参数

这种架构设计体现了参数效率的极致追求。值得注意的是,GLM-4.5的参数量仅为DeepSeek-R1的1/2、Kimi-K2的1/3,但在多项标准基准测试中的表现却更为出色,充分验证了架构设计的优越性。

训练方法论的系统性突破

三阶段渐进式训练流程

GLM-4.5的训练采用了严格的三阶段渐进式方法:

第一阶段:基础预训练 在15万亿token的通用数据集上进行基础预训练,构建模型的基础语言理解和生成能力。

第二阶段:领域特化训练 使用8万亿token的代码、推理、智能体特定数据进行针对性训练,并将上下文长度扩展到128K,为特定任务场景提供专业化能力。

第三阶段:强化学习优化 通过强化学习进一步增强模型的推理、代码和智能体能力,实现能力的深度整合和优化。

开源强化学习框架Slime

为支持大规模模型的强化学习训练,智谱AI开发并开源了RL基础框架Slime,该框架具备以下创新特性:

- 灵活的混合训练架构:支持同步和异步训练,解耦数据生成和模型训练,最大化GPU利用率

- 解耦的智能体设计:将耗时的环境交互与训练引擎分离,解决智能体任务中数据生成的瓶颈

- 混合精度加速:采用FP8格式进行数据生成,BF16进行模型训练,在保证质量的前提下大幅提升训练速度

性能表现的全面领先

综合评测的卓越成绩

在业界最具代表性的12个评测基准中,包括MMLU Pro、AIME24、MATH 500、SciCode、GPQA、HLE、LiveCodeBench、SWE-Bench、Terminal-bench、TAU-Bench、BFCL v3和BrowseComp,GLM-4.5取得了令人瞩目的成绩:

![图片[1]-GLM-4.5:中国AI的技术突破与Agent时代的开源先锋](https://sorry.chaofanaigc.com/wp-content/uploads/2025/08/W020250729346173809329-1024x703.png)

- 全球模型排名:第三位

- 国产模型排名:第一位

- 开源模型排名:第一位

这一成绩充分验证了GLM-4.5在技术实力上的全面领先地位。

实战编程能力的验证

在真实场景的Agent Coding测试中,智谱团队设计了严格的对比实验:52个编程开发任务,涵盖前端开发、工具开发、数据分析、测试和算法实现等六大开发领域,全部在独立容器环境中进行多轮交互测试。

测试结果显示:

- 相对于Kimi-K2的胜率:53.9%

- 相对于Qwen3-Coder的胜率:80.8%

- 虽然与Claude-4-Sonnet相比仍有提升空间,但在大部分场景中已可实现平替效果

经济性优势的产业意义

突破性的成本控制

GLM-4.5在成本控制方面实现了突破性进展,API调用价格设定为:

- 输入:0.8元/百万tokens

- 输出:2元/百万tokens

这一定价相比主流模型降低了80%以上,仅为Claude价格的十分之一,为AI技术的普惠化应用奠定了基础。

对于开发者而言,除了模型本身的优惠定价外,选择合适的API服务平台同样重要。Poloapi是一个强大的AI API聚合平台,专注于提供稳定、高效的API连接服务,为开发者与企业简化技术对接流程。核心优势在于通过专业资源整合与智能调度,显著优化API调用成本,相比直接对接官方渠道,能帮助您更经济地实现所需功能。这种第三方API聚合服务的出现,进一步降低了开发者使用先进AI模型的门槛。

高效的部署性能

高速版本的实测生成速度超过100 tokens/秒,支持低延迟、高并发的实际部署需求。推荐配置为8块H20 GPU即可运行GLM-4.5推理版本,大幅降低了部署门槛。

开源生态的深度贡献

全面开放的开源策略

GLM-4.5采用MIT License开源协议,在Hugging Face与ModelScope平台同步发布,支持商业使用。这种开放策略为AI技术的广泛应用和创新发展提供了重要支撑。

广泛的生态兼容性

GLM-4.5支持多种主流推理框架:

- 推理框架:transformers、vllm、OpenCompass

- 量化部署:llama.cpp和ggml量化部署路线

- Agent平台:LangChain、OpenAgent、Coze、AutoGen等智能体平台

这种广泛的兼容性确保了模型能够快速集成到现有的AI应用生态中。

产业影响与战略意义

中国AI技术的里程碑

GLM-4.5的发布具有重要的产业战略意义。在当前AI技术竞争格局中,国外厂商在基础模型技术上长期占据优势地位,而GLM-4.5的成功发布表明中国AI技术已经在某些关键领域实现了技术突破,特别是在开源领域达到了世界领先水平。

Agent应用的技术基座

作为专为智能体应用设计的基础模型,GLM-4.5为Agent时代的到来提供了重要的技术支撑。其原生融合的多重能力架构,使得单一模型就能胜任复杂的智能体任务,从而简化了应用开发的技术栈,降低了Agent应用的开发门槛。

开源策略的产业价值

在当前AI技术发展的关键节点,开源策略的价值愈发凸显。GLM-4.5的全面开源不仅促进了技术的快速传播和应用,更重要的是为整个AI生态的健康发展提供了重要的技术基础设施。

技术发展趋势的深度思考

从模型规模竞赛到效率竞赛

GLM-4.5的成功表明,AI技术发展正在从单纯的”模型规模竞赛”转向更加理性的”效率竞赛”。通过架构创新和训练方法优化,可以在更小的参数规模下实现更好的性能表现,这为AI技术的可持续发展指明了方向。

多能力融合的技术趋势

GLM-4.5率先实现的推理、编码、智能体能力的原生融合,代表了大模型技术发展的重要趋势。未来的AI模型将不再是单一功能的专用工具,而是具备多重通用智能能力的综合平台。

AGI发展的技术路径

GLM-4.5的技术实现为AGI(人工通用智能)的发展提供了重要的技术验证。其”在不损失原有能力的前提下融合更多通用智能能力”的设计理念,正是通向AGI的重要技术路径之一。

挑战与展望

技术挑战的持续应对

尽管GLM-4.5在多个维度实现了技术突破,但在与国际顶尖模型的对比中,仍然存在一定的提升空间。特别是在某些复杂推理任务上,距离Claude-4-Sonnet等顶级模型仍有差距,这需要在后续版本中持续改进。

应用场景的深度拓展

作为Agent原生基础模型,GLM-4.5的真正价值将在实际应用中得到验证。如何在各个垂直领域中充分发挥其多重能力优势,将是下一阶段的重要发展方向。

开源生态的持续建设

虽然GLM-4.5已经在开源生态建设方面做出了重要贡献,但要真正形成繁荣的开源AI生态,还需要在社区建设、开发者支持、应用案例等方面持续投入。

结语:技术突破与产业变革的交汇点

GLM-4.5的发布不仅仅是一个新模型的推出,更代表了中国AI技术发展的重要里程碑。其在技术架构、训练方法、性能表现、经济性等多个维度的创新,为AI技术的发展提供了新的思路和方向。

在全球AI技术竞争日趋激烈的今天,GLM-4.5以其开源开放的策略和卓越的技术性能,为中国AI技术在国际舞台上赢得了重要话语权。更重要的是,其Agent原生的设计理念和多能力融合的技术路径,为即将到来的AI Agent时代提供了重要的技术基础。

展望未来,随着GLM-4.5在各个应用场景中的深度部署和持续优化,我们有理由相信,这一技术突破将催生更多创新应用,推动AI技术向着更加智能、更加实用、更加普惠的方向发展。在这个技术突破与产业变革的交汇点上,GLM-4.5无疑将成为AI发展史上的重要节点。

暂无评论内容